Trong quá trình tối ưu SEO kỹ thuật cho website, file robots.txt là một thành phần quan trọng giúp kiểm soát việc thu thập dữ liệu của các công cụ tìm kiếm. Nhiều người làm SEO thường thắc mắc robot txt là gì và tại sao file này lại ảnh hưởng đến khả năng index của website trên Google.

Hiểu đơn giản, robot txt là gì chính là một tệp văn bản được đặt trong thư mục gốc của website nhằm hướng dẫn các bot tìm kiếm như Googlebot cách thu thập dữ liệu trên trang web. Khi được cấu hình đúng, file này giúp tối ưu quá trình crawl, tránh thu thập những trang không cần thiết và cải thiện hiệu quả SEO.

Bài viết dưới đây sẽ giúp bạn hiểu rõ robot txt là gì, cách tạo file robot txt, cách kiểm tra và tối ưu file robots.txt để website hoạt động hiệu quả hơn trên công cụ tìm kiếm.

Robots.txt là gì?

Khi tìm hiểu robot txt là gì, có thể hiểu đây là tệp văn bản đơn giản được đặt tại thư mục gốc của website với mục đích hướng dẫn các bot tìm kiếm cách thu thập dữ liệu trên trang web. File này giúp quản trị viên kiểm soát những trang nào được phép hoặc không được phép crawl.

Trong SEO kỹ thuật, việc hiểu rõ robot txt là gì giúp website tránh việc bot thu thập dữ liệu những trang không cần thiết như trang quản trị, trang đăng nhập hoặc các trang trùng lặp nội dung. Ngoài ra, robots.txt còn có thể liên kết với sitemap để giúp Google hiểu rõ cấu trúc website hơn.

Một số chức năng chính của robots.txt:

- Kiểm soát bot truy cập vào website

- Chặn các thư mục không cần index

- Hỗ trợ bot tìm sitemap

- Tối ưu ngân sách crawl (crawl budget)

Việc hiểu đúng robot txt là gì sẽ giúp quản trị website triển khai SEO kỹ thuật hiệu quả hơn.

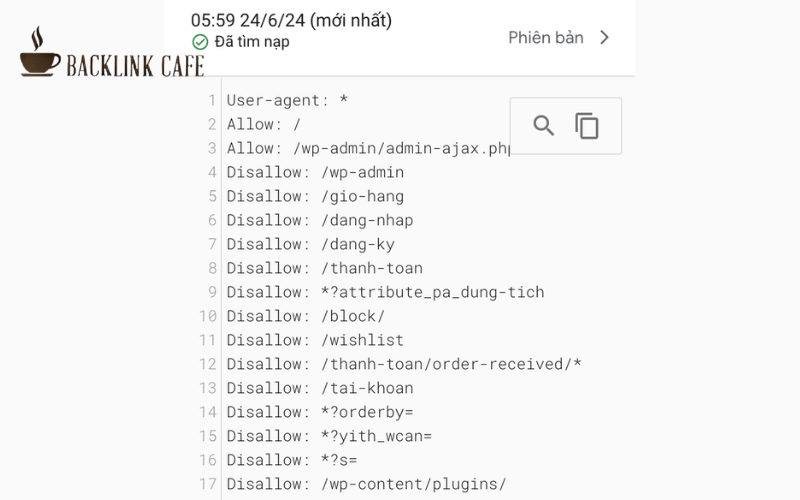

Robots.txt có cú pháp như thế nào?

Để hiểu rõ hơn robot txt là gì, bạn cần biết cấu trúc và cú pháp của file robots.txt. File này thường sử dụng các chỉ thị đơn giản để hướng dẫn bot tìm kiếm.

Các cú pháp phổ biến gồm:

| Cú pháp | Ý nghĩa |

| User-agent | Xác định bot tìm kiếm |

| Disallow | Chặn bot truy cập vào thư mục |

| Allow | Cho phép bot truy cập |

| Sitemap | Khai báo vị trí sitemap |

| Ví dụ: User-agent: *Disallow: /admin/Allow: /Sitemap: https://example.com/sitemap.xml |

Trong đó:

- User-agent: chỉ định bot tìm kiếm

- Disallow: chặn bot truy cập

- Sitemap: khai báo sitemap là gì và vị trí của sitemap

Việc nắm rõ cú pháp giúp bạn dễ dàng tạo file robot txt là gì và cấu hình đúng cho website.

>> Xem thêm: Domain Authority là gì? Cách tăng chỉ số DA cho website hiệu quả, an toàn

Tại sao cần sử dụng file Robots.txt?

Sau khi hiểu robot txt là gì, câu hỏi tiếp theo là vì sao website cần sử dụng file này. Robots.txt đóng vai trò quan trọng trong việc tối ưu SEO kỹ thuật và quản lý việc thu thập dữ liệu của bot tìm kiếm.

Một số lợi ích khi sử dụng robots.txt:

- Kiểm soát bot truy cập vào website

- Tránh index các trang không cần thiết

- Tối ưu ngân sách crawl của Google

- Bảo vệ các khu vực quản trị website

Ngoài ra, khi cấu hình đúng robots.txt và sitemap, website sẽ giúp bot tìm kiếm hiểu rõ cấu trúc trang. Vì vậy việc kiểm tra robot txt định kỳ là điều cần thiết để đảm bảo website không bị chặn index nhầm.

Khi hiểu rõ robot txt là gì, doanh nghiệp có thể kiểm soát tốt hơn việc hiển thị nội dung trên Google.

Cách tối ưu robots.txt giúp SEO hiệu quả hơn

Sau khi hiểu robot txt là gì, bước tiếp theo là tối ưu file này để cải thiện hiệu quả SEO. Robots.txt có thể giúp Googlebot thu thập dữ liệu website hiệu quả hơn nếu được cấu hình đúng.

Một số cách tối ưu robots.txt gồm:

- Chặn các trang không cần index

- Cho phép bot truy cập trang quan trọng

- Khai báo sitemap chính xác

- Kiểm tra robots.txt định kỳ

Checklist tối ưu robots.txt:

- Không chặn nhầm trang quan trọng

- Luôn khai báo sitemap

- Kiểm tra lỗi crawl trong Google Search Console

- Đảm bảo cú pháp đúng chuẩn

Việc tối ưu robots.txt kết hợp với sitemap là gì sẽ giúp Google thu thập dữ liệu website nhanh hơn và cải thiện hiệu quả SEO.

>> Xem thêm: Cách Chạy GDN Là GÌ? Hướng Dẫn Chạy Google Display Network Hiệu Quả Cho Người Mới

Hướng dẫn tạo file robots.txt cho website

Sau khi hiểu robot txt là gì, bạn có thể tiến hành tạo file robot txt cho website. Có nhiều cách khác nhau để tạo robots.txt tùy theo nền tảng website.

Cách tạo robots.txt thủ công

Đây là cách đơn giản nhất để tạo file robot txt.

Các bước thực hiện:

- Mở Notepad

- Viết các chỉ thị robots.txt

- Lưu file với tên robots.txt

- Upload lên thư mục gốc website

| Ví dụ:User-agent: *Disallow: /admin/Allow: /Sitemap: https://domain.com/sitemap.xml |

Cách này phù hợp với hầu hết các website.

Cách tạo robots.txt cho WordPress

Nếu bạn sử dụng WordPress, việc tạo file robot txt sẽ đơn giản hơn nhờ các plugin SEO.

Các plugin phổ biến:

- Rank Math

- Yoast SEO

- All in One SEO

Các plugin này cho phép chỉnh sửa robots.txt trực tiếp trong dashboard mà không cần truy cập hosting.

Cách tải file robots.txt lên website

Sau khi tạo xong robots.txt, bạn cần tải file lên thư mục gốc của website.

Các bước:

- Truy cập hosting hoặc FTP

- Mở thư mục public_html

- Upload file robots.txt

- Kiểm tra bằng URL:

| domain.com/robots.txt |

Sau đó bạn có thể kiểm tra robot txt bằng Google Search Console.

>> Xem thêm: Entity SEO là gì? Cách sử dụng SEO Entity hiệu quả, tỷ lệ index cao

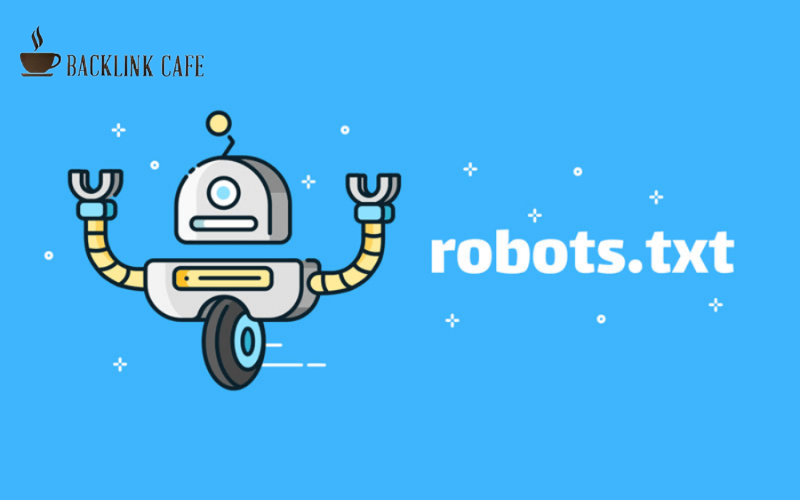

Ví dụ file robots.txt chuẩn cho website

Dưới đây là một số ví dụ robots.txt giúp bạn hiểu rõ hơn robot txt là gì và cách áp dụng cho từng loại website.

Robots.txt cho website WordPress

| User-agent: *Disallow: /wp-admin/Allow: /wp-admin/admin-ajax.phpSitemap: https://domain.com/sitemap.xml |

File này cho phép bot truy cập nội dung nhưng chặn khu vực quản trị.

Robots.txt cho website bán hàng

| User-agent: *Disallow: /cart/Disallow: /checkout/Disallow: /account/Allow: /Sitemap: https://domain.com/sitemap.xml |

File này giúp bot tránh crawl các trang thanh toán.

Robots.txt cho website tin tức / blog

| User-agent: *Allow: /Disallow: /tag/Disallow: /search/Sitemap: https://domain.com/sitemap.xml |

Điều này giúp tránh index các trang tag hoặc tìm kiếm trùng lặp.

>> Xem thêm: Local SEO là gì? Cách tối ưu local SEO hiệu quả cho doanh nghiệp

Dịch vụ SEO và Backlink chất lượng tại Backlink123

Nếu bạn đang muốn tăng thứ hạng website và tối ưu SEO tổng thể, Backlink123 là đơn vị cung cấp dịch vụ SEO và backlink chất lượng được nhiều doanh nghiệp lựa chọn.

Ưu điểm của Backlink123:

- Hệ thống website vệ tinh mạnh: Nội dung chất lượng, giúp đặt backlink tự nhiên và tăng độ uy tín website.

- Backlink từ nhiều nguồn uy tín: Liên kết từ blog, web 2.0 và website chuyên ngành giúp hồ sơ backlink đa dạng.

- Chiến lược SEO Offpage an toàn: Triển khai theo quy trình chuẩn, hạn chế spam backlink.

- Đội ngũ SEO kinh nghiệm: Tư vấn chiến lược SEO phù hợp từng lĩnh vực.

- Báo cáo minh bạch: Theo dõi backlink, thứ hạng từ khóa và traffic rõ ràng.

Liên hệ Backlink123 để được tư vấn chiến lược SEO giúp website tăng trưởng bền vững.

Qua bài viết trên, bạn đã hiểu rõ robot txt là gì, vai trò của file robots.txt cũng như cách tạo file robot txt và tối ưu file này cho website. Khi kết hợp robots.txt với sitemap là gì và các yếu tố SEO kỹ thuật khác, website sẽ được Google thu thập dữ liệu hiệu quả hơn.

Việc kiểm tra robot txt thường xuyên cũng giúp đảm bảo website không gặp lỗi crawl hoặc bị chặn index ngoài ý muốn. Nếu được thiết lập đúng cách, robots.txt sẽ trở thành công cụ hỗ trợ SEO kỹ thuật rất hiệu quả.